Scala編程指南 大數據分析中的數據處理與存儲支持服務

引言:Scala在大數據生態系統中的角色

Scala作為一門集面向對象與函數式編程范式于一身的語言,憑借其強大的表達力、類型安全性和與Java的無縫互操作性,已成為大數據分析領域的首選編程語言之一。特別是在Apache Spark等主流分布式計算框架中,Scala不僅是原生支持的語言,更因其簡潔高效的特性,成為處理海量數據、構建復雜分析管道的利器。本指南旨在系統介紹如何利用Scala進行數據處理,并探討其與各類存儲服務的集成支持,以助力開發者構建穩健、高效的大數據應用。

第一部分:Scala核心特性助力數據處理

1. 函數式編程范式

Scala的函數式特性,如不可變性、高階函數和模式匹配,為數據處理提供了天然優勢。不可變數據結構確保了線程安全,便于并行處理;map、filter、reduce等高階函數使數據轉換鏈清晰可讀;模式匹配則簡化了復雜數據結構的解構與邏輯分支處理。

2. 強大的類型系統

Scala的靜態類型系統和類型推斷機制,能在編譯期捕獲許多錯誤,提升代碼可靠性。結合case class和trait,可以優雅地定義數據模型,確保數據處理過程中的類型安全,減少運行時異常。

3. 并發與并行處理

通過Akka等actor模型庫或原生Future/Promise,Scala支持高效的并發編程。在處理大規模數據時,能輕松實現異步任務和分布式計算,充分利用集群資源。

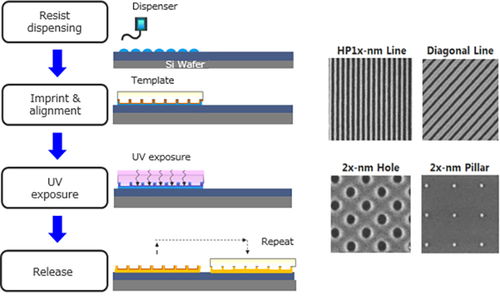

第二部分:數據處理實踐:從ETL到分析

1. 數據攝取與清洗

使用Scala結合Apache Spark,可以方便地從CSV、JSON、Parquet等格式中讀取數據。通過DataFrame API或Dataset API(強類型),進行缺失值處理、異常值過濾、格式標準化等清洗操作。例如:`scala

val df = spark.read.json("path/to/data.json")

val cleaned = df.filter("age > 0").na.fill(Map("name" -> "Unknown"))`

2. 轉換與聚合

利用Spark的轉換操作(如select、groupBy、join)和聚合函數(如sum、avg),實現數據重塑與匯總。Scala的鏈式調用使代碼流暢:`scala

val aggregated = cleaned.groupBy("department").agg(avg("salary").alias("avg_salary"))`

3. 機器學習與高級分析

通過MLlib庫,Scala支持常見的機器學習算法(如分類、聚類、推薦)。可以構建管道(Pipeline)將特征工程、模型訓練和評估串聯起來,實現端到端的分析流程。

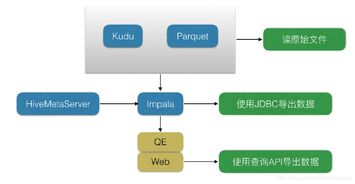

第三部分:存儲支持服務集成

1. 分布式文件系統:HDFS

Scala通過Hadoop API或Spark的封裝,可直接讀寫HDFS上的數據。這為持久化原始數據、中間結果和最終輸出提供了可靠存儲。

2. 數據湖與云存儲

與Amazon S3、Azure Blob Storage、Google Cloud Storage等云存儲服務的集成,可通過相應SDK或Spark配置輕松實現。Scala程序能跨云環境處理數據,支持混合架構。

3. 數據庫與數據倉庫

- NoSQL數據庫:如Cassandra、MongoDB,通過官方Scala驅動或Spark連接器,支持高效讀寫。

- 關系型數據庫:使用JDBC或特定庫(如Slick),進行OLTP操作或批量數據遷移。

- 數據倉庫:如Snowflake、Redshift,利用Spark連接器執行復雜查詢和數據加載。

4. 消息隊列與流存儲

對于實時數據處理,Scala可與Kafka、Pulsar等消息系統集成,通過消費者/生產者API實現流式攝取。結合Spark Streaming或Akka Streams,構建低延遲的數據管道。

第四部分:最佳實踐與優化建議

- 代碼組織:采用模塊化設計,將數據邏輯、業務規則和存儲訪問分離,提升可維護性。

- 性能調優:合理緩存(

persist)、分區數據、避免shuffle,以優化Spark作業。使用foreachPartition進行批量存儲操作,減少連接開銷。 - 錯誤處理:利用Scala的

Try、Either等類型優雅處理異常,確保管道容錯性。 - 測試:借助ScalaTest或Specs2,對數據處理邏輯進行單元和集成測試,模擬存儲交互。

- 監控與日志:集成SLF4J記錄關鍵指標,結合Prometheus等工具監控作業健康度。

###

Scala以其獨特的語言特性和豐富的生態系統,為大數據分析提供了從數據處理到存儲集成的全方位支持。通過掌握核心編程技巧,并結合Spark等框架及各類存儲服務,開發者能夠構建出高效、可擴展的數據應用。隨著數據規模的持續增長,深入理解Scala在大數據場景下的應用,將成為數據工程師和科學家的重要競爭力。

---

注:本指南基于Scala 2.x及Apache Spark 3.x版本,實際應用中請參考最新官方文檔。

如若轉載,請注明出處:http://m.lfdelihuagong.com/product/52.html

更新時間:2026-02-17 22:24:54